东数西算战略下的数据中心变革 液冷GPU服务器的演进与数据处理存储新范式

在“东数西算”国家工程的宏大叙事中,数据中心作为算力基础设施的核心,正经历一场从架构到技术的深刻变革。其中,以高密度、高性能计算为核心的GPU服务器,其散热瓶颈日益凸显,液冷技术从可选项变为必选项,并驱动着数据处理与存储支持服务向更高效、更绿色的方向演进。

一、 液冷GPU服务器:从“边缘尝试”到“主流标配”的发展路径

1. 驱动力:“东数西算”的集约化与高算力需求

“东数西算”旨在将东部密集的算力需求有序引导至西部可再生能源丰富的地区。这促使数据中心向超大规模、高密度方向发展。传统的风冷技术已难以满足单机柜功率密度持续攀升(特别是搭载多颗高性能GPU的服务器)的散热需求。液冷技术凭借其远超空气的导热能力,成为破解散热困境、提升能源利用效率(PUE)的关键。在西部枢纽节点,结合当地气候与能源结构,液冷方案能更有效地利用自然冷源,实现极低的PUE值。

- 技术演进:从冷板式到浸没式的深化

- 冷板式液冷:目前规模化部署的主流方案。GPU等主要发热元件通过冷板直接带走热量,其余部件仍采用风冷。其部署相对容易,改造成本较低,是当前许多数据中心向液冷过渡的首选。

- 浸没式液冷:代表未来方向的革命性技术。将整个服务器或发热部件浸没在绝缘冷却液中,实现极致散热和静音。它不仅能支持更高的功率密度(远超50kW/机柜),还能省去风扇、空调等部件,大幅降低系统能耗。随着“东数西算”对能效指标的严格要求,以及AI训练、科学计算等对极限算力的追求,单相和相变浸没式液冷将逐步从试点走向规模化应用。

3. 生态成熟:标准化、模块化与智能化

发展重点将从单一散热技术,转向整体解决方案的成熟。包括冷却液配方、管路接口的标准化;机柜级、集群级的模块化交付,以简化部署和维护;以及集成智能监控系统,实时监测流量、温度、泄漏等参数,实现预测性维护和能效动态优化。

二、 数据处理与存储支持服务的协同演进

液冷GPU服务器的普及,不仅改变了物理基础设施,更对上层的数据处理与存储服务提出了新要求,并创造了新可能。

- 计算与存储架构的重构

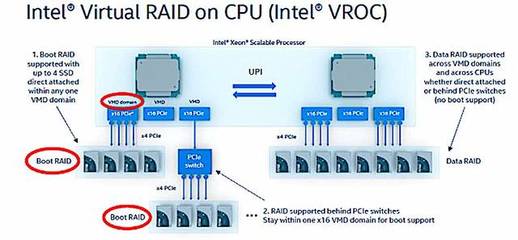

- 解耦与池化:高密度液冷GPU集群更倾向于采用计算与存储资源解耦的架构。通过高速网络(如InfiniBand、RoCE)将计算池(液冷GPU服务器集群)与独立的大规模存储池(包括高性能全闪存阵列和对象存储)相连。这避免了存储资源分散在每台服务器中,提升了资源利用效率和数据共享的灵活性,更适合西部数据中心集中处理来自东部的多样化算力任务。

- 近存储计算:为降低数据在计算与存储间迁移的延迟和带宽压力,在存储系统或智能网卡中集成计算能力(如DPU、IPU),进行数据预处理、过滤、压缩等操作,实现“数据不动计算动”,这对处理“西算”中的海量数据尤为关键。

- 数据服务模式的创新

- 绿色数据服务:依托西部绿色能源和液冷技术带来的极低PUE,数据中心运营商可以提供带有“碳足迹”标签的算力与存储服务,满足企业对ESG的要求。

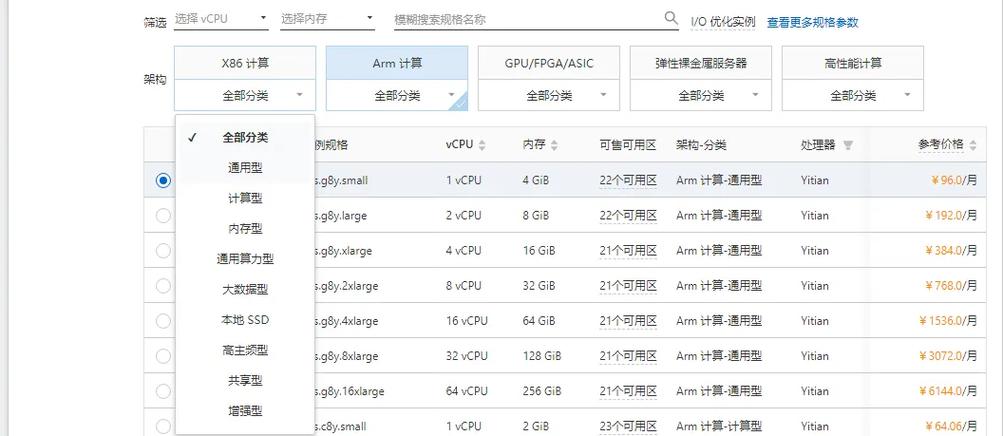

- 一体化智算服务:面向AI大模型训练等场景,提供从液冷GPU算力集群、高速互联网络、到并行文件系统、大规模深度学习框架优化的一站式服务,降低用户使用超算的门槛。

- 数据调度与流动性服务:在“东数西算”的跨区域格局下,服务重点之一是实现数据高效、安全、经济的跨枢纽调度。这需要强大的数据编排引擎,能够根据数据热度、计算任务优先级、能源成本等因素,智能决策数据存放位置(东部近岸热数据缓存 or 西部冷存储)和计算地点。

- 存储技术的适配性发展

- 高性能存储:为匹配液冷GPU服务器的高速计算能力,全闪存阵列、NVMe-oF技术将成为标准配置,提供微秒级延迟和超高带宽。

- 高密度节能存储:对于海量温冷数据,采用高密度硬盘柜并结合液冷机柜环境进行优化设计,在有限空间内最大化存储容量,同时控制能耗。

- 存储可靠性新挑战:在浸没式液冷环境中,存储介质(如SSD、HDD)的长期兼容性与可靠性需经过严格验证,驱动供应链进行针对性产品研发。

结论

“东数西算”战略为液冷GPU服务器提供了规模化应用的绝佳场景,而液冷技术的成熟又反过来保障了“西算”枢纽能够高效、绿色地承载起“东数”的算力需求。二者共同推动数据中心从“机房”向“算力工厂”蜕变。未来的数据处理与存储支持服务,将不再是孤立的资源提供,而是深度融合了先进散热技术、算存解耦架构、智能调度与绿色理念的一体化、服务化新型基础设施。这场由底至上、协同共进的变革,正为中国数字经济的均衡与可持续发展奠定坚实的算力基座。

如若转载,请注明出处:http://www.zdchumei.com/product/72.html

更新时间:2026-05-12 22:33:37